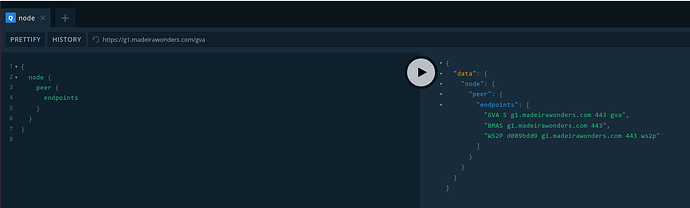

non, la requête retourne ton nœud uniquement a priori. Sur un nœud qui est défini ok sur ginkgo cela donne un résultat identique :

Ok autant pour moi, désolé de ce faux positif au sujet de GVA alors.

Merci d’avoir investigué.

L’incident semble se résorber, bravo!

A noter que de mon côté, mon noeud avait beaucoup plus de faciliter à garder le flow avec Duniter 1.9.0 (docker) qu’avec 1.8.7, même à partir de dump, sur la même machine. Je ne sais pas si c’est un hasard ou si ça révèle quelque chose.

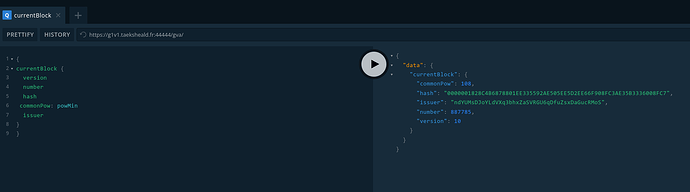

As I mentioned in another thread, the desynchronization in 1.9 nodes between BMA and GVA (actually, the GVA side gets stuck while the BMA remains synchronized) has been a common problem for some time.

In these cases, what we do is resynchronize from scratch, until after a few days of working well, the node gets stuck again on the GVA side, and we have to start all over again. We’ve been doing this all this time.

In my case, I just realized that my node is stuck on the GVA side again after few days working, so I’m resynchronizing.

The first attempt didn’t work, resulting in the following error:

duniter-1 | 2025-12-06T23:26:40+00:00 - info: Milestones 100%, Downloaded 100%, Applied 100%

duniter-1 | 2025-12-06T23:26:46+00:00 - info: blocks_chunk_215: 10885818 bytes

duniter-1 | 2025-12-06T23:29:19+00:00 - info: Mem2File [wotb]...

duniter-1 | 2025-12-06T23:29:19+00:00 - error: Unhandled rejection: Error: ruleToBeKickedArePresent

duniter-1 | 2025-12-06T23:29:19+00:00 - error: Error: ruleToBeKickedArePresent

duniter-1 | at Function.checkBlock (/duniter/app/lib/blockchain/DuniterBlockchain.js:179:19)

duniter-1 | at process._tickCallback (internal/process/next_tick.js:68:7)

This happened to me 5 or 6 times this week and I could only sync using an archive.

Yes, I’ve just used this now and my node is back. Thanks!

Je viens d’ajouter un backup journalier des data dans duniter_default pour mon noeud forgeron.

J’ai repris le script de @cgeek plus du crontab pour effectuer ça tous les jours vers 2h du matin.

Je devrais garder les 2-3 derniers backups (et il faut sans doute compter 10 minutes pour que le backup du jour soit disponible).

Pour info, il faut avoir le nom complet exact pour pouvoir télécharger l’archive, en se basant sur cette url, ou il faut remplacer yyyy par l’année, mm par le mois sur 2 caractères et dd par le jour sur 2 caractères.

https://downloads.g1.brussels.ovh/auto-backup-g1-brussels-ovh-1.8.7_yyyy-mm-dd_02-00.tgz

Exemple pour avoir un backup au 1er Juin 2024 (il n’existe pas sur le serveur):

yyyy=2024

mm=06

dd=01

https://downloads.g1.brussels.ovh/auto-backup-g1-brussels-ovh-1.8.7_2024-06-01_02-00.tgz

Çà , c’est de l’initiative excellente pour les forgerons en rade et pour remettre la v1 en route rapidement !! BRAVO !! merci à toi ![]()

![]()

quel version de noeud ? 1.8.7 ou 1.9dev ?

EDIT : Oups, réponse dans le lien à télécharger… 1.8.7

Bonjour, mon noeud est ko depuis le gros fork du week-end dernier.

Je tente des synchro mais sans grand succès jusqu’à aujourdhui.

Serait-il mieux que je monte mon noeud en V1.9 ou que je reste en V1.8.7 ?

@Damery Je pense que ce fork-ci ne peut pas se résoudre sans récupérer les données d’un autre nœud.

Tu peux récupérer mon backup journalier (voir mon post juste un peu plus haut en remplaçant la date par “2025-12-07” pour construire la bonne URL) et faire plus ou moins l’équivalent de ce que poka mentionnait pour appliquer le backup:

Si ton nœud est via docker, il faut adapter un peut et retrouver ou est ton répertoire pour le volume docker “data”.

Je peux aider si c’est le cas et que tu as du mal à retrouver l’emplacement du volume docker ou…

Merci Nicolas, non, je ne suis pas sous docker pour Duniter V1

J’ai copié ton archive mais je n’avais pas mis de côté le conj.json depuis 2023 … Est-ce grave, docteur ?

Comment le reconstruire ?

Je ne connais pas assez bien pour te répondre; je peux juste dire que le fichier contient de la configuration qui n’a pas l’air très sensible; mais une partie semble spécifique au noeud lui même, genre le “remotehost”/“remoteport” qui ne seraient pas corrects chez toi.

Probablement que @cgeek ou d’autres pourraient dire comment recréer ou reconstruire le fichier conf.json si tu l’as malheureusement supprimé ?

Le fichier se reconstruit tout seul au lancement du nœud. Simplement il prend alors les valeurs par défaut.

La dernière version où je fais un cp pour chaque fichier/dossier nécessaire ? Car il y avait des effets de bord avec l’ancienne version où je supprimais les fichiers non désirés, par exemple j’avais ton dump dans le dossier et celui-ci avait été inclus avec cette approche.

Oui, la version ou on ne copie que ce qui est nécessaire sans delete ![]()

ok, ce soir je laisse tomber et demain matin, dés que possible, je télécharge la sauvegarde du 8/12 de Nicolas et m’y remets en espérant qu’il n’y aura pas trop de nouveaux bloks entre 2h du matin et quand je me réveille ![]()

Téléchargement de la dernière sauvegarde de brussels.ovh, extract dans mon .config/duniter, remplacement du keyring et noeud lancé le 8 puis aujourd’hui encore et je vois dans la log les lignes suivantes (et ces messages depuis 9h ce matin)

2025-12-09T17:30:19+01:00 info WS2P: connected to peer C3oqFogS using `WS2P g1.duniter.org 443`!

2025-12-09T17:30:19+01:00 info Fork resolution: 47 potential block(s) found…

2025-12-09T17:30:19+01:00 info Fork resolution: block #612750-00000029 is known as incorrect. Skipping.

2025-12-09T17:31:17+01:00 info [HJ7U5CeY] ![]() PEER 6DrGg8cf 888956-0

PEER 6DrGg8cf 888956-0

2025-12-09T17:31:17+01:00 warn Unknown reference block of peer

2025-12-09T17:32:17+01:00 info WS2P: connection [C3oqFogS `WS2P g1.duniter.org 443`] has been closed

Voyez-vous ce que je dois faire ?

Après un reboot de la VM, le noeud semble être reparti

J’ai relancé ce “docker compose”

mais la synchro se bloque au bloc880249

De ce que j’ai pu lire dans ce fil, on peut récupérer la DB d’un noeud synchro pour se mettre à jour.

laquelle je pourrai récupérer ?

Si ton nœud est en version 1.8.7, tu peux prendre mon backup de ce matin.

Tu peux recréer l’url en remplaçant la date par “2025-12-09”.

Utilisé à l’instant, fonctionne comme un charme ![]()

Pour info j’ai forké au bloc 889682, j’ai du resync à nouveau.