La ĞDev est relancée

- Release: runtime-700

- Docker : duniter-v2s-gdev (x86 et ARM)

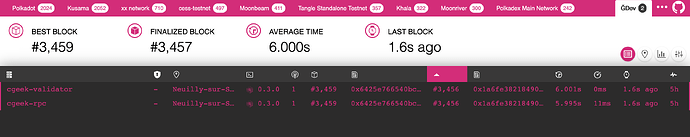

- Télémétrie : Polkadot Telemetry

Le bootnode par défaut est mon nœud gdev.cgeek.fr.

Les données Ğ1 sont celles d’aujourd’hui 08h15 environ.

Le build ARM64 ne semble pas être passé, je relance.

Je n’ai pas pu tester l’image Docker AMD64, je vous laisse ce soin car je n’ai déjà plus de temps pour aujourd’hui (cc @Pini si tu passes par là pour vérifier).

Édit : les images Docker ne sont pas fonctionnelles, nous allons les reconstruire.

Edit 2 : c’est bon ! les images AMD64 et ARM64 fonctionnent toutes les deux, j’ai pu tester :

docker run --rm -it -e DUNITER_CHAIN_NAME=gdev duniter/duniter-v2s-gdev

[...]

2023-11-19 16:22:01 ***** Duniter has fully started *****

2023-11-19 16:22:06 ✨ Imported #3420 (0x930b…f085)

2023-11-19 16:22:06 💤 Idle (2 peers), best: #3420 (0x930b…f085), finalized #3417 (0x810b…2370), ⬇ 231.5kiB/s ⬆ 4.2kiB/s

2023-11-19 16:22:11 💤 Idle (2 peers), best: #3420 (0x930b…f085), finalized #3418 (0x3674…5b89), ⬇ 1.1kiB/s ⬆ 0.7kiB/s

2023-11-19 16:22:12 ✨ Imported #3421 (0xfa18…82d8)

Bon, pour l’instant je suis tout seul, je vous attend ![]()