Voici un état du storage que je ne comprends pas:

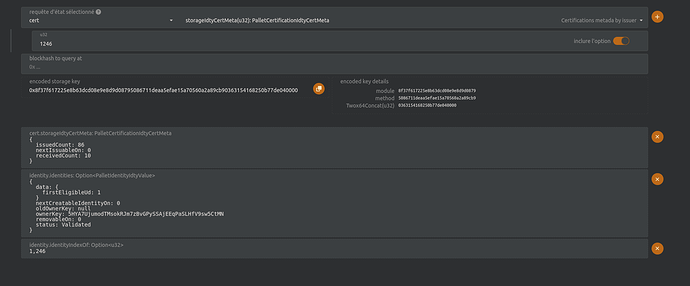

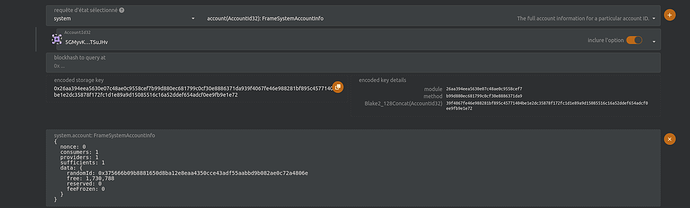

Pour l’identité Damery:

- pubkey v1: HJ7U5CeYLQZrP76yRP7WgHnMvJggxeTTYW8wDJDwf42f

- address v2: 5HYA7UjumodTMsokRJm7zBvGPySSAjEEqPaSLHfV9sw5CtMN

- Certifications reçus dans le jsons genesis: 44 (c’est le bon chiffre, vous verrez sur Cesium que 2 de ses 46 certifications proviennent de non membres, qui eux sont filtrés dans mon genesis)

Ensuite dans le storage:

cert.certsByReceiver: Vec<(u32,u32)>

[

[

30

1,118,762

]

[

119

2,029,354

]

[

302

3,065,959

]

[

331

7,413,134

]

[

437

2,310,473

]

[

500

8,833,276

]

[

504

2,546,931

]

[

510

7,412,034

]

[

1,048

6,475,232

]

[

1,179

5,929,103

]

[

1,286

9,515,699

]

[

1,287

324,980

]

[

1,331

5,903,576

]

[

1,339

9,867,941

]

[

1,500

4,157,608

]

[

1,593

8,665,021

]

[

1,786

8,776,916

]

[

2,179

955,177

]

[

2,527

1,520,893

]

[

2,658

3,270,125

]

[

2,998

2,152,810

]

[

3,015

7,213,662

]

[

3,064

5,990,904

]

[

3,087

4,171,217

]

[

3,152

1,869,456

]

[

3,224

2,216,094

]

[

3,257

3,954,727

]

[

3,683

5,150,291

]

[

3,861

5,596,018

]

[

3,868

4,688,878

]

[

3,879

4,705,238

]

[

4,185

3,179,969

]

[

4,240

1,729,956

]

[

4,562

7,219,638

]

[

4,574

2,319,689

]

[

4,658

2,671,141

]

[

4,761

6,519,124

]

[

4,836

4,716,496

]

[

5,457

1,867,470

]

[

5,564

5,588,509

]

[

5,979

1,926,421

]

[

6,222

2,943,451

]

[

6,236

4,171,217

]

[

6,253

8,994,198

]

]

44, le compte y est donc super.

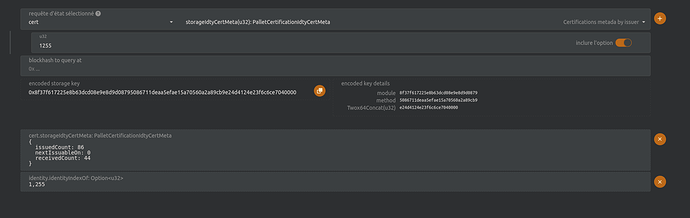

Mais par contre la valeur de storage cert.storageIdtyCertMeta["receivedCount"] vaut 10 !

Comment est-ce possible.

Vous verrez que c’est le cas pour presque toutes les identités, cert.storageIdtyCertMeta["receivedCount"] vaut moins que ce qui est contenu dans cert.certsByReceiver

Je précise qu’il n’y a que les membres actuels dans le genesis.